一种改进的渐进式图像超分辨率重建算法

时间:2022-12-09 09:05:04 来源:雅意学习网 本文已影响 人

刘 颖,谭仕立,毕 萍,朱婷鸽

(1.西安邮电大学 通信与信息工程学院,陕西 西安 710121;2.西安邮电大学 无线通信与信息处理技术国际联合研究中心,陕西 西安 710121;3.西安邮电大学 图像与信息处理研究所,陕西 西安 710121)

单帧图像超分辨率重建(Single Image Super-Resolution,SISR)是指由一幅低分辨率(Low-Resolution,LR)图像重建出一幅对应的高分辨率(High-Resolution,HR)图像,是计算机视觉和图像处理的重要技术之一[1-2],现已广泛应用于医学图像增强、视频成像和目标识别等计算机视觉任务。然而,从LR图像中能够生成多个不同的HR图像,因此SISR是一个不适定问题。为了解决这个逆问题,大量学习LR与HR图像之间映射关系的超分辨率(Super-Resolution,SR)重建算法相继被提出。

目前,超分辨率重建主要分为基于卷积神经网络[3-11](Convolutional Neural Network,CNN) 和基于生成对抗网络[12-14](Generative Adversarial Nets,GAN) 两类方法。基于卷积神经网络的图像超分辨率[3](Super-Resolution Convolutional Neural Networks,SRCNN)是最早将卷积网络应用于SISR的方法,其重建效果优于非神经网络方法。超深度卷积网络[4](Very Deep Convolutional Networks,VDSR)引入残差学习,扩展了网络的深度。基于亚像素卷积的超分辨率[5](Efficient Sub-Pixel Convolutional Neural Network,ESPCN)方法在最后一层引入亚像素卷积网络,将LR特征图重新排列从而得到超分辨率图像。基于卷积神经网络的快速超分辨率[6](Fast Super-Resolution Convolutional Neural Networks,FSRCNN)方法在模型末尾使用反卷积层直接学习原始LR图像与HR图像之间的映射关系。LapSRN[7]方法利用拉普拉斯金字塔网络逐步重建HR图像的残差。文献[8]利用多尺度残差块构建了高质量网络。基于CNN的SISR方法表现出了优异的性能,大多数方法倾向于使用更大、更深的网络重建图像,但训练这些模型需要更多的数据、时间和资源,开销大但效果甚微。随后,学者们开始关注网络轻量化,如:文献[9]通过多次回传机制减少网络参数;

利用级联残差网络[10](Cascading Residual Network,CARN)提出了轻量化的超分辨率方法;

稀疏掩码超分辨率[11](Sparse Mask Super-Resolution,SMSR)网络利用空域掩码与通道掩码构建稀疏卷积,大幅减少了模型的计算量。

在另一类基于GAN的SISR方法中,基于生成对抗网络的图像超分辨率[12](Super-Resolution Generative Adversarial Network,SRGAN)方法把重建问题看作是图像生成问题,通过生成器和判别器的不断博弈从而达到视觉效果更好的重建结果。基于GAN的重建方法往往峰值信噪比(Peak Signal-to-Noise Ratio,PSNR)不高,但其重建结果视觉效果好。采用GAN训练获得高效益的同时,常常也伴随着极大的风险,这类方法训练过程不稳定、训练曲线震荡较大、耗费资源多,不易掌控。

观察上述两类方法的模型可以发现,其均是直接通过最小化损失函数学习LR图像和HR图像之间的映射关系。然而,缺乏自然图像的先验信息使得真实的高频细节信息重建尤为困难。因此,结合图像先验信息的重建方法成为另一类研究方向。图像先验信息包括总变差先验[13]、稀疏先验[14]和边缘先验[15]等,其中边缘先验最容易获取,因此使用最为广泛。深边缘引导循环残差[16](Deep Edge Guided Recurrent Residual,DEGR)网络将图像边缘信息与递归网络相结合,提出了边缘引导的递归残差网络。软边缘提取网络SeaNet[17]从LR图中提取软边缘,并将其与重建的SR图像进行卷积融合,学习到了更加丰富的高频细节。残差通道注意力网络[18](Residual Channel Attention Networks,RCAN)提出了通道注意力机制,通过对特征通道之间的相互依赖性建模,自适应地重新缩放每个通道的特征,使网络专注于更有用的通道。二阶注意力网络[19](Second-order Attention Network,SAN)提出了二阶通道注意力机制,即利用二阶梯度统计特性自适应的调整不同通道特征图的权重。整体注意力网络[20](Holistic Attention Network,HAN)引入了层注意力模块和通道空间注意力模块,分别学习不同层特征的权重以及各层特征的通道和空间相关性,获得了较好的重建结果。但是,当遇到高倍数放大时,上述方法的效果并不理想。因此,拟对SeaNet模型进行改进,提出一种改进的渐进式图像超分辨率重建算法。通过构建两层渐进式SISR网络实现LR图像的重建,即网络整体结构分为第一级放大重建和第二级细节重建。第一级放大重建中采用渐进式两级放大重建结构,在残差模块中引入注意力机制,将注意力图与输入特征图相乘以进行自适应特征优化,将更多资源分配给对重建起关键作用的特征通道中。第二级细节重建中采用软边缘提取网络提取图像的边缘细节,使得重建结果在第一阶段的基础上有所提升。

1.1 两层渐进式网络结构

基于CNN架构的两层渐进式网络结构如图1所示。第一层渐进式网络是指整个网络分为两个阶段,即第一阶段的放大重建网络和第二阶段的细节重建网络。第二层渐进式网络是指在放大重建网络中,先进行图像特征提取,然后在重建阶段采用一级放大和二级放大的逐级放大结构。

图1 两层渐进式网络结构

在第一阶段,粗超分辨率重建网络的输出可表示为

frough=FRIRN(ILR)

(1)

式中:FRIRN为粗超分辨率重建网络;

ILR为输入的LR图片。

在第二阶段,软边缘网络提取的边缘和融合层的输出结果分别表示为

fedge=FEdge-Net(ILR)

(2)

ffusion=Ffusion([frough,fedge])

(3)

式中,FEdge-Net为软边缘提取网络;

[]表示连接操作。

最终图像重建的结果为

ISR=FIRN(ffusion)

(4)

式中,FIRN为细超分辨率重建网络。

因此,第i个训练样本的网络损失函数为

(5)

1.2 渐进式粗超分辨率重建网络

渐进式放大网络结构可以逐步修正重建图像中的细节信息,尤其对高倍数放大的效果好。因此,粗超分辨率重建网络采用渐进式的三级结构,如图1中渐进式粗超分辨率重建网络所示。LR图像特征提取阶段为第一级,由n1个残差块组成,主要用于对LR图像进行特征提取。一级放大阶段为第二级,通过反卷积层将LR图像进行一级放大,再送入n2个残差块中进一步提取一级放大后图像的特征。二级放大阶段为第三级,再次通过反卷积层将一级放大后的图像放大至目标尺寸,得到粗超分辨率重建结果frough。

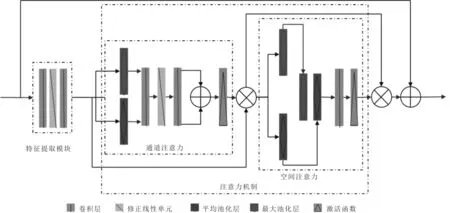

在第一级和第二级网络中均使用由特征提取模块和卷积块的注意力模块[21](Convolutional Block Attention Module,CBAM)组成的残差网络结构,如图2所示。

图2 残差块结构

第m个残差块的输出定义为

fb,m=[W2(W1fb,m-1+b1)+b2+Fc]+fb,m-1

(6)

式中:fb,m-1为第m-1个残差块的输出,也是当前残差块的输入;

W1和W2分别为该残差块中第一层和第二层卷积层的权重;

b1和b2分别为对应的偏置;

为ReLU函数;

Fc为注意力模块网络。

特征提取模块由两个卷积层和一个修正线性单元组成,CBAM由通道注意力和空间注意力两部分串行组成。通过在通道和空间两个独立维度中依次推断注意力图,利用不同通道之间特征表示的相互依赖和相互作用,学习特征相关性,从而准确而快速地定位出目标区域,增强SR图像的特征,同时抑制无用的噪声。在残差块中加入注意力机制的策略可以提高网络的学习能力,更有助于保留更细致的图像特征。

重建图像分辨率的提高是一个渐进的过程,因此低阶特征对后续高阶特性的影响较小,所以在残差块中并没有使用长跳跃连接。

1.3 软边缘提取网络

一幅图像通常包含变化平缓的区域和变化剧烈的区域,事实上,变化平缓的区域主要由图像的低频信息构成,变化剧烈的区域主要由图像的高频信息构成,在视觉上体现为边缘。

不同于传统的Canny、Sobel和Roberts等图像边缘,由散度和梯度定义的软边缘也可以准确地保留图像的高频信息,故IEdge可定义为

IEdge=div(ux,uy)

(7)

软边缘提取网络SeaNet将多尺度残差网络[22](Multi-scale Residual Network,MSRN)作为基本结构,并对其进行两点改进:1)减少多尺度残差块的数量,降低复杂度;

2)将学习ILR与IHR之间的映射应用于学习ILR与IEdge之间的非线性关系。

软边缘提取网络的损失函数定义为

Edge=‖E(ILR-IEdge)‖1

(8)

式中:E(·)表示软边缘提取网络;

E(ILR)表示提取的软边缘图像。

不同网络提取的软边缘示例如图3所示。软边缘提取网络包含了放大模块,因此提取的软边缘图像与HR图像有相同的维度,使得目标物边缘清晰,重建效果更好,而Canny边缘中存在噪声和不连续点,对重建结果造成了影响。

图3 网络提取的软边缘

1.4 细节重建网络

第二阶段的细节重建网络,分为融合层和细超分辨率重建网络两部分。

在重建前,需将软边缘提取网络得到的高频特征加入到第二阶段的网络中,故采用一个卷积层作为融合层,其输出可定义为

ffusion=max(0,Wm[frough,fedge]+bm)

(9)

式中,Wm和bm分别为卷积层的权重和偏置。

细节重建网络由两个卷积层和n3个残差块构成,其中残差块由两个卷积层和一个修正线性单元组成,每个残差块的输出可定义为

fr,n=[W4(W3fr,n-1+b3)+b4]+fr,n-1

(10)

式中:W3和W4分别为该残差块中第一层和第二层卷积层的权重;

b3和b4分别为对应的偏置;

为ReLU函数,fr,n-1为前一个残差块的输出,也是当前残差块的输入,则全局残差块输出为

fout=fr,n3+finput

(11)

式中,fr,n3和finput分别表示最后一个残差块的输出和第一个残差块的输入。

在训练过程中,利用L1正则化定义内容损失函数content,计算SR图像与HR图像之间的最小差别,即

content=‖ISR-IHR‖1

(12)

综上,总损失函数则可被定义为

total=content+λedge

(13)

至此,两层渐进式网络虽然由3部分网络组成,但是3部分网络之间呈前后关联的关系,从而实现了端到端的一个整体的网络训练。

2.1 实验环境及数据集选取

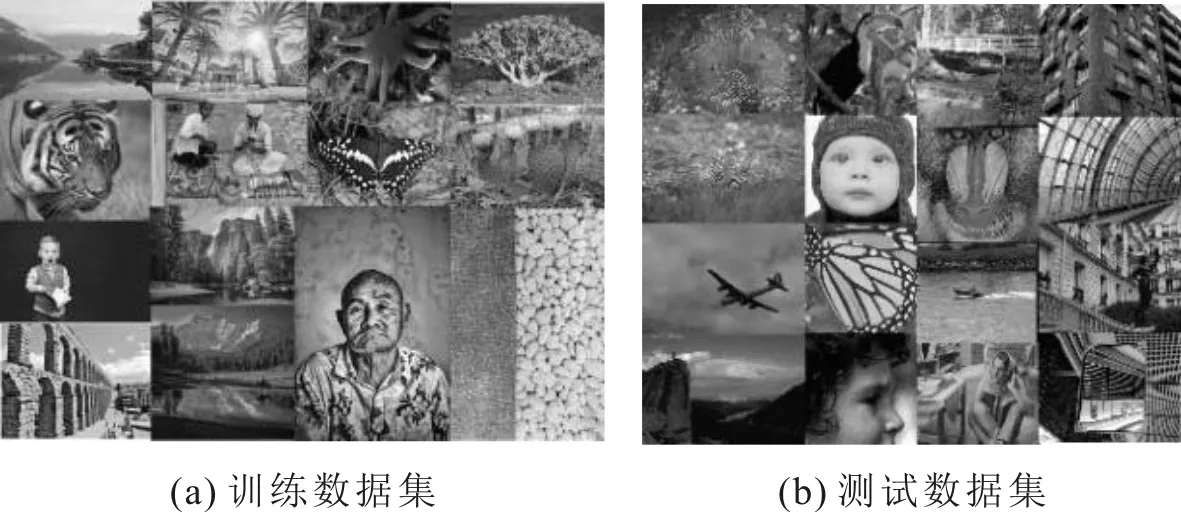

实验环境为NVIDIA Titan X GPU、pytorch 1.0版。选取DIV2K[23]为训练数据集,其包含800幅训练图像,示例如图4(a)所示。选取BSDS100[24]、Set5[25]、Set14[26]和Urban100[27]数据集为测试数据集,示例分别按列如图4(b)所示,其包含多类场景图像。

图4 数据集选取示例

2.2 训练策略

图像预处理分为两步:第一步,利用式(7)提取DIV2K训练图像的软边缘,将其作为软边缘提取网络的目标边缘;

第二步,通过双三次插值的方法将训练图像下采样得到LR图像,将其作为整个网络的输入。网络中每个残差块的输入和输出通道数均为64,且残差块的卷积核大小均为3×3,其中,n1=12,n2=3,n3=40。

训练时,迭代周期为750,初始学习率为0.000 1,学习率每隔200个周期减半。网络的损失函数曲线如图5所示。

图5 损失函数曲线

2.3 结果分析

根据PSNR和结构相似性(Structural Similarity,SSIM)客观评价指标,分别对比改进算法与含有图像先验信息的重建算法SelfExSR[27]、A+[28]、级联结构卷积网络(Cascaded Structure Convolutional Network Multi-View,CSCN-MV)[29]、SMSR[11]、DEGREE-MV[30](Deep Edge guided Recurrent Residual Multi-View)、ENet[31]、EINet[32]、SeaNet和无图像先验信息的重建算法Bicubic、SRCNN、ESPCN、FSRCNN、VDSR、深度递归网络[33](Deeply Recursive Convolutional Network,DRCN)、LapSRN、DRRN[34]、MemNet[35]、MSRN的性能,结果分别如表1和表2所示。计算时需将所有图像转换到YCbCr空间并提取Y分量进行计算。

表1 改进算法与含有图像先验信息的重建算法的性能对比

表2 改进算法与无图像先验信息的重建算法的性能对比

表1中SelfExSR、A+和CSCN-MV均为非神经网络算法,ENet和EINet为基于GAN架构的重建算法,其余算法为基于CNN架构的重建算法。由表1可知,基于CNN架构的重建算法的PSNR值要高于其余两类算法。与EINet算法相比,后者使用的是Canny边缘,而改进算法采用软边缘,图像重建质量更高。对比SeaNet算法,改进算法设计了逐级放大网络结构,提升了重建放大阶段的图像重建质量,获得了较好的重建结果。自集成策略是指将测试图像经过水平翻转、垂直翻转和转换通道后再进行测试,之后对多个结果取均值,可以看出,改进算法引入该策略后性能有所提升。

表2中所列算法均是基于CNN架构的图像重建算法,由表2可知,采用CNN架构并加入边缘先验信息,可以同时提升图像的重建效果。另外,LapSRN也同样采用了渐进式策略进行重建,但改进算法结构更复杂,网络结构更深,因此重建结果更好。

改进算法与非神经网络的学习模型Bicubic和SelfExSR,以及基于CNN和GAN的神经网络模型SRCNN、VDSR、LapSRN、MSRN等部分典型重建算法的视觉效果对比分别如图6和图7所示。

图6 4倍放大的部分实验结果

图7 8倍放大的部分实验结果

由图6和图7可以看出,改进算法重建结果边缘清晰可见,而且可以避免锯齿效应。如图6中第一组图,改进算法对比其他算法恢复的边缘更加清晰连续。如图7的第二组图,改进算法恢复的蝴蝶翅膀边缘更加完整平滑,可以恢复出更清晰的图像细节信息,图像重建结果更好。

两层渐进式策略的SISR重建算法将SeaNet网络框架进行改进,分为放大重建和细节重建两个阶段。在放大重建阶段,采用了逐级放大的策略实现LR图像到SR图像的重建,保留了图像更多的细节特征。在放大网络中采用残差结构,并在残差块中加入了注意力机制,增强了目标图像的特征。实验结果表明,改进算法取得的客观评价指标比其他算法效果好,获得了更加清晰化边缘的超分辨率结果,且极大减少了锯齿效应。下一步SISR研究工作可从以下几个方面展开:在进行细节重建前,探索粗SR图像与提取到的软边缘图像进一步融合的策略;

尝试利用图像其他先验信息实现SR;

结合基于GAN架构的EINet和基于CNN架构的重建算法的优点,得到PSNR和SSIM两个均优的指标作为未来的研究方向。